AI Overviews do Google ainda entregam respostas erradas em escala massiva

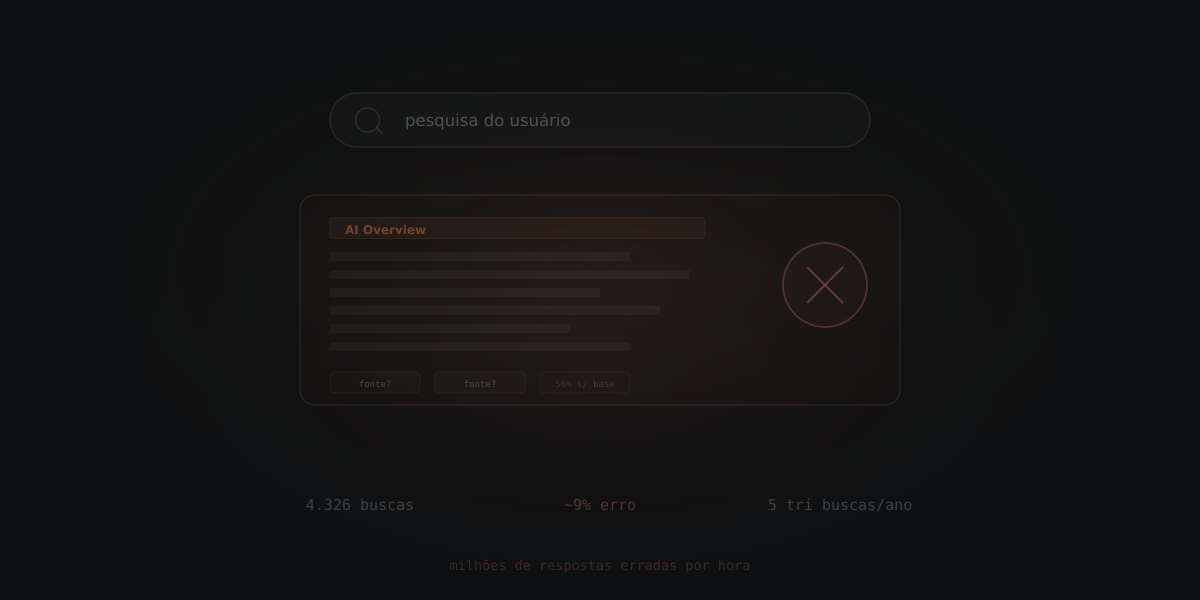

Estudo da Oumi para o NYT testou 4.326 buscas e revelou que os resumos de IA do Google erram quase 1 em cada 10 respostas — milhões de erros por hora na escala da plataforma.

Os AI Overviews, resumos gerados por inteligência artificial que o Google exibe no topo da busca, voltaram ao centro da polêmica após uma análise indicar que a ferramenta ainda entrega respostas erradas em escala enorme. O ponto mais incômodo para o Google é que o sistema até melhorou, mas continua distante de um nível de confiabilidade que justificaria a autoridade com que aparece na tela.

O levantamento foi feito pela startup Oumi a pedido do The New York Times e testou 4.326 buscas em dois momentos diferentes: em outubro, quando os resumos eram alimentados por uma versão ligada ao Gemini 2, e em fevereiro, já com a mudança para o Gemini 3. O resultado mostrou evolução, mas também escancarou o tamanho do problema quando a escala do Google entra na conta.

O número parece bom, até virar um problema gigantesco

No recorte mais recente, os AI Overviews acertaram cerca de 91% das respostas. Na rodada anterior, o índice era de 85%. À primeira vista, o avanço parece positivo. O problema é que o Google processa mais de 5 trilhões de buscas por ano. Em um volume desse tamanho, errar perto de 1 em cada 10 respostas significa espalhar milhões de respostas incorretas por hora.

É aí que a discussão muda de patamar. O debate deixa de ser "a IA ainda erra?" e passa a ser "quantas pessoas estão recebendo uma resposta errada com aparência de verdade?". Quando o resumo vem pronto, no topo da busca, com tom seguro e links ao lado, muita gente simplesmente assume que aquilo já foi checado. E esse efeito de confiança automática transforma um erro estatístico em risco real de desinformação.

O problema não é só errar. É citar sem sustentar

O dado mais preocupante da análise talvez nem seja a taxa bruta de erro. Segundo o estudo, cresceu o número de respostas classificadas como "ungrounded", ou seja, resumos em que os links mostrados pelo Google não sustentavam de forma clara o que a IA afirmava. Em outubro, isso aparecia em 37% dos casos analisados. Em fevereiro, esse índice subiu para 56%.

Na prática, isso cria um problema ainda mais traiçoeiro. A resposta pode até parecer confiável porque vem acompanhada de fonte, mas o usuário que clicar nem sempre encontra ali a base exata da afirmação feita pela IA. Ou seja: o sistema não apenas pode errar, como também pode dar a sensação de que está bem amparado quando não está.

Os exemplos ajudam a entender por que isso assusta

A análise trouxe casos concretos. Em uma busca sobre quando a casa de Bob Marley virou museu, o Google respondeu 1987, quando o ano correto era 1986. Em outra, o sistema apontou que não havia registro da entrada de Yo-Yo Ma em determinada instituição, mesmo linkando para uma página relacionada ao tema. Também houve caso em que a IA acertou a idade na morte de Dick Drago, mas errou a data do falecimento.

Esses exemplos mostram um ponto importante: não se trata só de delírios absurdos ou respostas obviamente erradas. Muitas vezes, o erro é pequeno, plausível e fácil de passar despercebido. E justamente por isso ele pode ser mais perigoso, porque entra no fluxo da consulta como se fosse apenas um detalhe confiável.

Google contesta, mas a pressão só aumenta

O Google rebateu a análise e disse que o estudo tem "falhas sérias" e não reflete o que as pessoas realmente pesquisam na plataforma. A empresa sustenta que os AI Overviews são mais confiáveis porque combinam o modelo de IA com os sistemas tradicionais de ranking e segurança da própria busca. Ainda assim, a reação mostra que a companhia já entendeu o tamanho do desgaste quando os erros deixam de ser casos isolados e passam a ser lidos como um efeito estrutural do produto.

Esse desgaste vem se somando a outra frente de pressão: a relação cada vez mais tensa com os publishers. Críticos afirmam que os AI Overviews usam conteúdo da web para responder diretamente ao usuário, reduzindo cliques e enfraquecendo quem produz a informação original. Quando esse cenário se junta aos erros e às citações frágeis, a percepção de risco cresce ainda mais.

No fim, a crítica mais dura não é que a IA do Google erre. Toda tecnologia desse tipo erra. O que assusta é a combinação entre escala massiva, posição privilegiada na página e aparência de autoridade. Quando isso se junta, um erro deixa de ser só um tropeço técnico e passa a virar uma máquina de espalhar informação duvidosa com a força da maior busca do planeta.

Quer ver o atalay.ia na sua redação?

Solicitar demonstração