Anthropic vaza código do Claude Code e expõe risco da IA que escreve software

Erro em atualização do Claude Code expôs mais de 500 mil linhas de código e ampliou a pressão sobre a Anthropic.

A Anthropic entrou em crise após vazar parte do código interno do Claude Code, sua ferramenta de programação com inteligência artificial. O episódio ganhou repercussão imediata porque a empresa vinha sendo apresentada como um dos maiores exemplos da nova fase da engenharia de software, em que agentes de IA escrevem, testam e executam tarefas com cada vez menos intervenção humana.

O caso ficou ainda mais simbólico porque Boris Cherny, uma das principais vozes ligadas ao produto, havia defendido publicamente que já não escrevia código manualmente havia meses. A fala ajudou a consolidar a imagem da Anthropic como vitrine de um novo modelo de desenvolvimento. Agora, a mesma companhia se vê obrigada a explicar como deixou escapar justamente o código de uma de suas ferramentas mais estratégicas.

O que aconteceu no vazamento

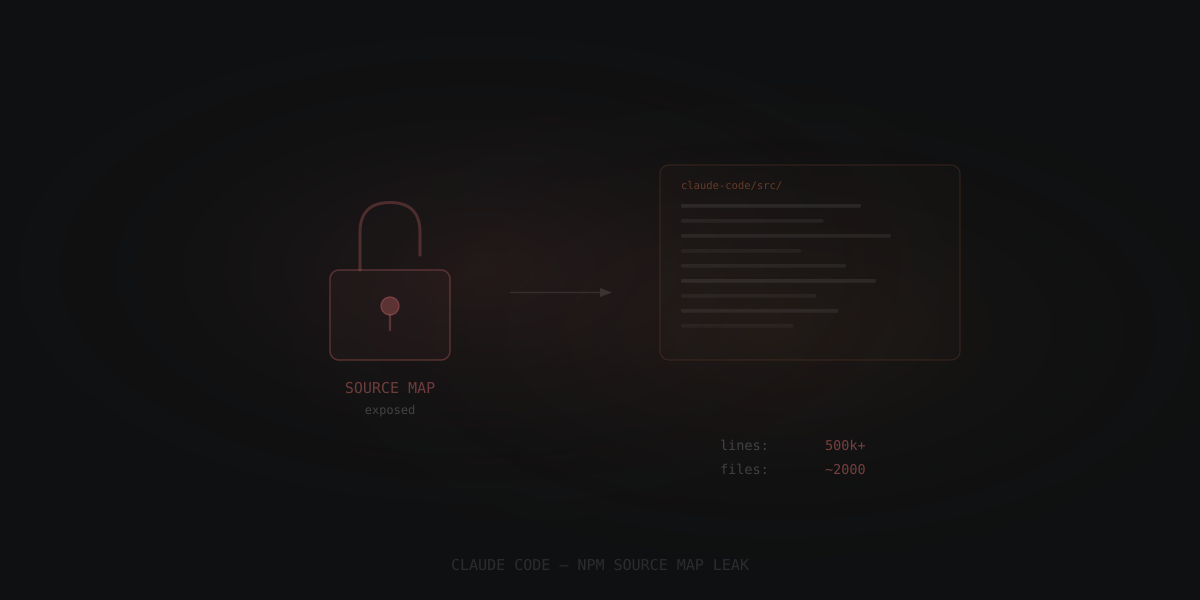

Segundo a própria Anthropic, o problema foi causado por um erro humano no processo de empacotamento de uma atualização. Em vez de um ataque externo, o que houve foi a publicação indevida de um arquivo de depuração, conhecido como source map, dentro de uma release do Claude Code. Esse tipo de arquivo pode permitir que terceiros reconstruam boa parte do código original de uma aplicação.

Foi exatamente isso que aconteceu. A atualização publicada no npm acabou expondo uma fatia extensa da base TypeScript da ferramenta, com relatos apontando para mais de 500 mil linhas de código. Em pouco tempo, desenvolvedores começaram a baixar, copiar e analisar o material, que se espalhou rapidamente por repositórios públicos e fóruns da comunidade técnica.

Por que o caso é tão delicado

A Anthropic afirmou que nenhum dado sensível de clientes ou credencial foi exposto. Isso evita um problema ainda maior com usuários e empresas clientes, mas não transforma o caso em algo pequeno. O que foi revelado não eram apenas arquivos soltos: o vazamento abriu uma janela para entender como a companhia organiza permissões, comportamentos do agente, fluxos internos e partes importantes da lógica que tornam o Claude Code um produto competitivo.

Na prática, o mercado passou a enxergar parte do "motor" por trás do assistente. Isso interessa a muita gente. Concorrentes podem estudar escolhas técnicas da Anthropic com mais precisão. Pesquisadores de segurança podem analisar pontos frágeis. E agentes maliciosos ganham uma visão mais detalhada de como a ferramenta funciona, o que pode facilitar a busca por vulnerabilidades ou formas de contornar proteções.

O contraste com o discurso de código feito por IA

O vazamento chamou atenção não apenas pelo conteúdo exposto, mas pelo simbolismo. A Anthropic vinha sendo tratada como uma das empresas que melhor exemplificam a tese de que a IA já está escrevendo software em escala real. A declaração de Boris Cherny, de que seu código já era integralmente produzido com ajuda de IA, reforçou essa narrativa e ajudou a transformar o Claude Code em referência no setor.

Por isso, o incidente bate diretamente na credibilidade desse discurso. O problema não prova que a IA causou o vazamento, e a empresa sustenta que a falha foi humana. Ainda assim, o episódio expõe uma contradição desconfortável: quanto mais uma companhia vende a ideia de velocidade, automação e autonomia no desenvolvimento, maior passa a ser a cobrança sobre seus controles operacionais, seus processos de release e sua maturidade em segurança.

O que a Anthropic perde com isso

Mesmo sem atingir os modelos centrais do Claude, o vazamento representa um golpe reputacional e estratégico. O Claude Code se tornou um dos ativos mais importantes da empresa na disputa com rivais como OpenAI e Google. Ao deixar esse código escapar, a Anthropic oferece ao mercado um atalho para entender parte de sua execução prática, justamente em um momento em que ferramentas de programação com IA viraram um dos campos mais disputados do setor.

A empresa correu para limitar os danos e tentar remover cópias espalhadas pela internet, mas esse tipo de contenção costuma chegar tarde demais. Quando o material já foi replicado, estudado e adaptado por terceiros, o prejuízo deixa de ser apenas técnico e passa a ser também competitivo. O episódio reforça a importância de práticas de divulgação responsável em incidentes de segurança. No fim, o episódio vira um lembrete duro para todo o setor: não basta prometer que a IA consegue escrever software; é preciso provar que a organização continua capaz de controlar o que publica.

Leia também: Anthropic corre para conter vazamento do Claude Code após defender código feito por IA

Quer ver o atalay.ia na sua redação?

Solicitar demonstração