NYT acusado de publicar artigo com IA: o que o caso ensina sobre uso responsavel nas redacoes

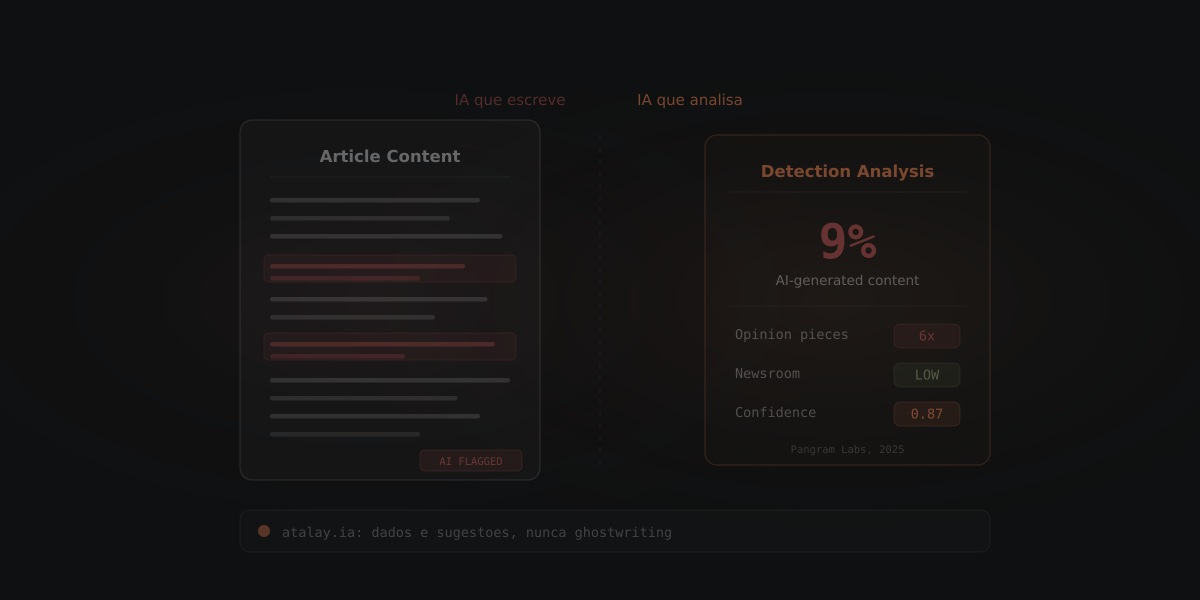

Uma analise da Pangram Labs revelou que 9% dos artigos de grandes jornais ja contem conteudo gerado por IA. O caso do New York Times expoe o dilema central: usar IA para escrever ou para informar decisoes editoriais?

Em novembro de 2025, um ensaio publicado na coluna "Modern Love" do New York Times acendeu um debate que se espalhou por redacoes do mundo inteiro. O texto, assinado por Kate Gilgan e intitulado "I Was Deemed Unfit to Be a Mother", foi publicamente acusado de ter sido gerado por inteligencia artificial. O caso nao e isolado: uma analise da Pangram Labs revelou que aproximadamente 9% dos artigos publicados por grandes veiculos ja contem conteudo parcial ou totalmente gerado por IA. O que isso significa para o jornalismo?

O que aconteceu no New York Times

A acusacao partiu de Becky Tuch, editora do Lit Mag News, que publicou no X (antigo Twitter) que o ensaio de Gilgan "parece exatamente texto genérico de IA" (no original, "reads EXACTLY like AI slop"). Criticos apontaram padroes linguisticos tipicos de modelos de linguagem: paralelismos excessivos ("not X, not X, but Y"), uso repetido da "regra de tres", e uma fluidez superficial que carece de fricao humana.

O debate escalou rapidamente. Kate Gilgan acabou reconhecendo que usou ChatGPT, Claude e Gemini como "editor colaborativo" — para "inspiração, orientação e correção". A distincao entre usar IA como inspiracao e usar IA como redatora-fantasma tornou-se o centro da controversia.

O New York Times, por sua vez, declarou que jornalismo é "uma atividade inerentemente humana" e que sua política interna exige "supervisão humana" e "rotulagem clara" de qualquer uso de IA. Mas o caso expos a distancia entre politica institucional e pratica real.

O que os dados revelam: o estudo Pangram Labs

O caso do NYT nao existe no vacuo. A Pangram Labs, empresa especializada em deteccao de conteudo gerado por IA, conduziu uma analise sistematica de artigos publicados por grandes veiculos de comunicacao. Os resultados sao significativos:

- Aproximadamente 9% dos artigos recentemente publicados continham conteudo parcial ou totalmente gerado por IA.

- Artigos de opiniao eram 6 vezes mais propensos a conter conteudo gerado por IA do que materias produzidas por equipes de reportagem.

- A deteccao foi baseada em analise de padroes linguisticos, distribuicao de tokens e sinais estatisticos que diferenciam texto humano de texto sintetico.

Esses numeros indicam que o uso de IA na producao de conteudo jornalistico ja e uma realidade -- nao uma hipotese futura. E na maioria dos casos, acontece sem qualquer transparencia para o leitor.

IA que escreve vs. ferramenta editorial: a distinção que importa

Existe uma diferenca fundamental entre dois modelos de uso de IA em redacoes:

IA como redatora-fantasma

Nesse modelo, a IA gera o texto que sera publicado -- integralmente ou com edicoes cosmeticas. O jornalista atua como curador, nao como autor. O problema: o leitor acredita estar lendo um ser humano. A relacao de confianca editorial se rompe.

IA como ferramenta editorial

Nesse modelo, a IA analisa dados, sugere otimizacoes, detecta erros, identifica oportunidades de pauta -- mas nunca escreve o texto final. O jornalista continua sendo o autor. A IA informa decisoes; nao as toma. Como exploramos em por que IA generica nao funciona para jornalismo, o valor real esta no contexto que a IA traz, nao no texto que ela gera.

Essa distincao nao e apenas semantica. Ela define o que e uso responsavel. E o que os leitores e os algoritmos vao passar a cobrar com cada vez mais rigor.

O paradoxo da deteccao: como funciona e por que falha

Ferramentas de deteccao de IA, como as usadas pela Pangram Labs, analisam padroes estatisticos no texto: distribuicao de perplexidade (quao previsivel e cada palavra no contexto), entropia, e padroes de repetição estrutural. Modelos de linguagem tendem a produzir texto com perplexidade mais baixa e uniforme -- sao consistentemente "previsiveis".

Mas essas ferramentas tem limitacoes importantes:

- Falsos positivos: textos humanos com estilo formal e repetitivo podem ser erroneamente classificados como IA. Escritores tecnicos, academicos e colunistas com estilo formulaico sao frequentemente flagrados.

- Falsos negativos: texto gerado por IA e depois editado extensivamente por humanos pode passar despercebido. Quanto mais edicao humana, mais dificil a deteccao.

- Evolucao dos modelos: cada nova geracao de LLM produz texto mais "humano", reduzindo a eficacia dos detectores atuais. E uma corrida armamentista.

- Multilinguismo: a maioria dos detectores foi treinada em ingles. A eficacia em portugues e outros idiomas e significativamente menor.

Confiar exclusivamente em detectores de IA nao e uma estrategia viavel. A solucao precisa ser institucional, nao apenas tecnologica.

O que as grandes redacoes estao fazendo

O caso do NYT nao e o unico. Diversas redacoes ja adotam IA de formas variadas -- algumas transparentes, outras nao:

- Washington Post: usa IA para gerar resumos de podcasts, com rotulagem clara.

- Bloomberg: publica artigos com resumos gerados por IA, sinalizados como tal.

- Diversos veiculos: usam IA para gerar titulos alternativos para teste A/B, sem necessariamente divulgar.

- Ars Technica: demitiu um reporter que acidentalmente incluiu citacoes fabricadas por IA em uma materia.

O padrao que emerge e claro: quando a IA e usada para gerar conteudo, os riscos sao altos. Quando e usada para analisar e sugerir, os riscos sao gerenciaveis.

Quais politicas as redacoes precisam ter

Com base nos casos reais e nas diretrizes de organizacoes como o Reuters Institute e as proprias politicas do Google sobre conteudo de IA, redacoes que querem usar IA de forma responsavel precisam de:

- Politica de uso explicita: documentar o que e permitido e o que nao e. "Usar IA para pesquisa" e diferente de "usar IA para escrever o lide". Cada caso precisa de regra clara.

- Rotulagem transparente: quando IA contribuiu substancialmente para o conteudo, o leitor precisa saber. O Google ja afirmou que transparencia e um fator positivo.

- Revisao humana obrigatoria: nenhum conteudo gerado por IA deve ser publicado sem revisao editorial humana. Isso inclui titulos, resumos e legendas.

- Treinamento da equipe: jornalistas precisam entender o que a IA faz bem (analise de dados, deteccao de padroes, sugestoes) e o que ela faz mal (precisao factual, nuance, voz autoral).

- Auditoria periodica: revisar regularmente como a IA esta sendo usada na pratica, nao apenas na teoria. O gap entre politica e pratica, como o caso NYT mostrou, pode ser significativo.

O caso a favor da transparencia

Existe uma narrativa de que admitir o uso de IA enfraquece a credibilidade. Os dados mostram o contrario. Veiculos que sao transparentes sobre como usam IA -- para analise, otimizacao, sugestoes -- constroem mais confianca do que aqueles que usam IA escondida e sao eventualmente descobertos.

"A questao nao e se sua redacao usa IA. A questao e: ela usa IA para escrever no lugar do jornalista, ou para dar ao jornalista informacoes melhores? O primeiro caso destrói confianca. O segundo a constroi."

Como discutimos em como a IA pode respeitar a voz de cada jornalista, a tecnologia mais avancada nao e a que escreve melhor -- e a que entende o contexto editorial e oferece sugestoes que o jornalista consegue incorporar como suas, porque foram calibradas para o estilo dele.

IA que analisa dados vs. IA que gera texto

O caso do NYT cristaliza um dilema que toda redacao vai enfrentar. A linha divisoria e clara:

- Uso de baixo risco: IA para analisar dados de performance, detectar tendencias, sugerir otimizacoes de SEO, verificar conformidade com o manual de redacao, gerar opcoes de titulo para teste. Nenhum texto final e gerado pela IA.

- Uso de alto risco: IA para escrever artigos, gerar citacoes, produzir analises opinativas, criar conteudo publicavel. O jornalista deixa de ser autor e vira curador.

Essa e a abordagem que adotamos no atalay.ia: uma ferramenta que nunca escreve no lugar do jornalista. Que analisa dados reais de performance, identifica oportunidades de pauta, verifica aderencia ao manual, e sugere otimizacoes -- mas o texto final e sempre humano. Como detalhamos em como levar IA para a redacao de forma pratica, a adocao responsavel comeca com clareza sobre o papel da tecnologia.

O que isso significa para o futuro

O percentual de 9% identificado pela Pangram Labs tende a crescer. Os modelos estao ficando melhores. A tentacao de usar IA para produzir mais conteudo com menos gente vai aumentar, especialmente em redacoes sob pressao financeira -- um cenario que ja afeta a audiencia de jornais no Brasil.

Mas a historia do jornalismo mostra que atalhos de credibilidade cobram preco. Fabricar citacoes sempre foi motivo de demissao. Plagiar sempre foi motivo de demissao. Publicar como seu algo que nao e seu sempre foi motivo de demissao. O uso opaco de IA generativa e a versao contemporanea desses mesmos erros.

As redacoes que vao se destacar sao as que adotam IA como ferramenta de inteligencia -- nao de producao. Que usam dados para informar decisoes editoriais, nao para substituir o trabalho do jornalista.

O jornalismo e, como o proprio NYT definiu, "uma atividade inerentemente humana". A IA mais útil e a que potencializa esse trabalho humano -- nao a que tenta substitui-lo.

Quer ver o atalay.ia na sua redação?

Solicitar demonstração